mapreduce 大文件

- 作者: 纯洁已成过去

- 来源: 51数据库

- 2020-09-25

hadoop主要是hdfs和mapreduce两大框架,hdfs用来存储文件,mapreduce用来处理文件进行计算。1.首先,对于hdfs,dn负责存储文件,以及文件的副本,而nn负责存储文件的元数据,例如文件的块信息,以及位置信息等,这些数据会保存在nn的内存中,当存在很多的小文件时,每个小文件nn存储的元数据都是一样的,所以N个小文件会占用nn大量的内存,增大nn的负担。

2.而对于mapreduce来说,map的输入默认是一个输入文件对应一个map任务,所以如果不做特殊处理在使用mapreduce处理这些小文件时会一个小文件产生一个map。这样的话每个map只处理一个小文件,会造成很大的资源浪费,同时也会降低mapreduce的执行效率。

以上是我自己的理解,可能还有其他的原因。建议去网上自行搜索一些文章阅读。

1、存储文件的时候需要指定存储的路径,这个路径是hdfs的路径。而不是哪个节点的某个目录。比如./hadoop?fs?-put?localfile?hdfspat

一般操作的当前路径是/user/hadoop比如执行./hadoop?fs?-ls?.实际上就相当于./hadoop?fs?-ls?/user/hadoop

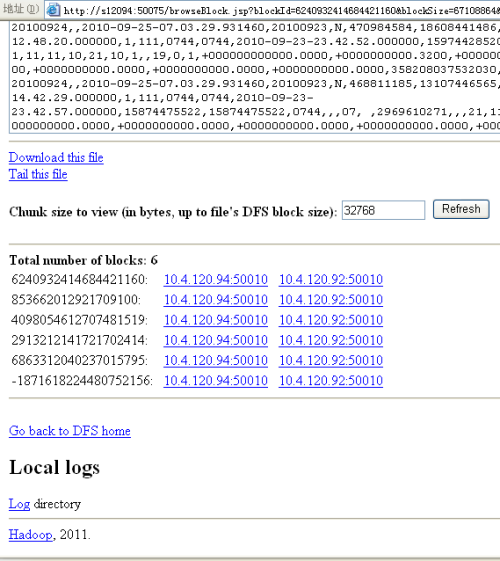

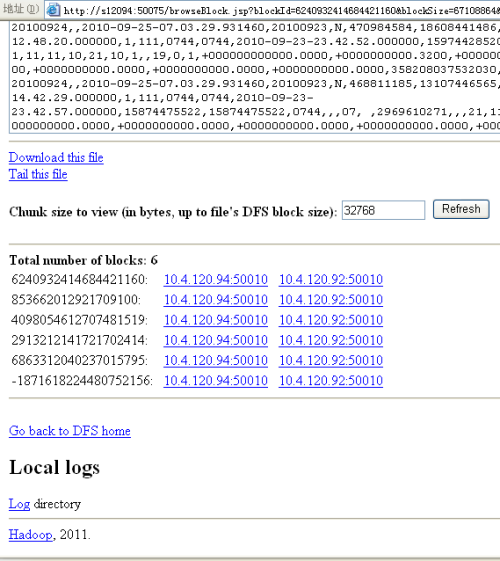

2、hdfs本身就是一个文件系统,在使用的时候其实不用关心具体的文件是存储在哪个节点上的。如果需要查询可以通过页面来查看,也可以通过api来实现查询。

2.而对于mapreduce来说,map的输入默认是一个输入文件对应一个map任务,所以如果不做特殊处理在使用mapreduce处理这些小文件时会一个小文件产生一个map。这样的话每个map只处理一个小文件,会造成很大的资源浪费,同时也会降低mapreduce的执行效率。

以上是我自己的理解,可能还有其他的原因。建议去网上自行搜索一些文章阅读。

1、存储文件的时候需要指定存储的路径,这个路径是hdfs的路径。而不是哪个节点的某个目录。比如./hadoop?fs?-put?localfile?hdfspat

一般操作的当前路径是/user/hadoop比如执行./hadoop?fs?-ls?.实际上就相当于./hadoop?fs?-ls?/user/hadoop

2、hdfs本身就是一个文件系统,在使用的时候其实不用关心具体的文件是存储在哪个节点上的。如果需要查询可以通过页面来查看,也可以通过api来实现查询。

推荐阅读